使用成熟的Tensorflow、PyTorch框架去实现递归神经网络(RNN),已经极大降低了技术的使用门槛。

变量bptt_truncate表示网络在反向传播时必须回溯的时间戳数,这样做是为了克服梯度消失的问题。

I被映射到索引2,like对应索引45,昆季厂家直销10KV/24KV欧式电缆,to对应索引10、**对应索引64而标点符号.** 对应索引1。

用于训练RNN,在给定第t+1个词作为输出的时候将第t个词作为输入,例如:在RNN单元输出字为“like”的时候给定的输入字为“I”.

现在输入是嵌入向量的形式,而计算损失函数(Loss)所需的输出格式是独热编码(One-Hot)矢量。

这是对输入字符串中除第一个单词以外的每个单词进行的操作,因为该神经网络学习只学习的是一个示例句子,而初始输入是该句子的第一个单词。

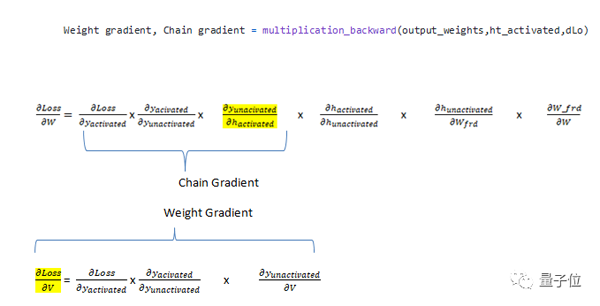

在multiplication_backward的情况下,返回2个参数,一个是相对于权重的梯度(dLoss / dV),永康市行知企业管理咨询有限公司另一个是链梯度(chain gradient),该链梯度将成为计算另一个权重梯度的链的一部分。

所以,计算梯度只需要这两个函数。multiplication_backward函数用于包含向量点积的方程,addition_backward用于包含两个向量相加的方程。

至此,已经分析并理解了RNN的反向传播,目前它是在单个时间戳上实现它的功能,之后可以将其用于计算所有时间戳上的梯度。

如下面的代码所示,forward_params_t是一个列表,其中包含特定时间步长的网络的前向参数。

变量ds是至关重要的部分,因为此行代码考虑了先前时间戳的隐藏状态,这将有助于提取在反向传播时所需的信息。

在此技术中,当前单元将只查看k个时间戳,而不是只看一次时间戳,其中k表示要回溯的先前单元的数量。

企业资料通过认证

企业资料通过认证